A preocupação com a exposição indevida de dados corporativos, vazamentos e usos não autorizados para treinamento de modelos ou qualquer outro é uma preocupação recorrente e legitima. Independentemente do porte ou setor temos recorrentemente escutado “Temos medo de nossos dados sigilosos serem expostos aos modelos que podem aprender e de alguma forma serem acessados de forma indevida”.

Seria essa então uma preocupação inédita nos tempos atuais e futuros com IA tradicional ou Generativa?

Cenários semelhantes ocorrem, por exemplo, no uso intensivo de ferramentas de Business Intelligence, que frequentemente extraem dados sensíveis para ambientes locais, expondo a organização a riscos operacionais, legais e reputacionais. Esses desafios se somam a questões estruturais como silos informacionais, ausência de semântica de dados padronizada e fragilidade nos processos de qualidade e classificação de dados.

Talvez, assim, a governança de IA poderia ser encarada como uma extensão ou evolução da governança de dados. Ambas compartilhando fundamentos críticos como a compreensão do ciclo de vida dos ativos de dados, linhagem, rastreabilidade dos modelos e algoritmos, definição da finalidade de uso, controle de acesso por perfil, conformidade com legislações de proteção de dados pessoais, segurança da informação e aderência a normas internacionais como a ISO/IEC 27001 e ISO/IEC 38507.

A implementação de planos de compliance é uma etapa fundamental nesse processo, mas igualmente relevante é a capacidade de aplicar esses planos de forma contínua e eficaz (Nosso querido enforcement), com apoio de metodologia e ferramentas que combinem automação, rastreabilidade e controle granular.

É com base nessa visão que o IBM watsonx.governance se posiciona: uma plataforma que habilita a governança de IA em ambientes corporativos complexos, promovendo transparência, explicabilidade, colaboração entre stakeholders e mitigação proativa de riscos. A solução oferece recursos para a automação de políticas, gestão do ciclo de vida de modelos, catalogação e classificação de dados, análise de impacto e conformidade com marcos regulatórios.

Reconhecida pela IDC como líder em seu estudo AI Governance MarketScape, a IBM reforça, por meio do watsonx.governance, seu compromisso com a implantação responsável e escalável de inteligência artificial no ambiente corporativo.

Concepção, Gestão e Aplicação Prática

Os Compliance Plans no watsonx.governance são artefatos formais que definem os requisitos, restrições e boas práticas que devem ser seguidos por modelos de IA ao longo de seu ciclo de vida. Esses planos têm como finalidade mitigar riscos regulatórios, operacionais e éticos, garantir transparência e explicabilidade dos modelos, sustentar auditorias e validações internas/externas, apoiar a conformidade com legislações como LGPD, GDPR e normas setoriais.

A criação de um plano parte da identificação do contexto de negócio e também regulatório, com definição do caso de uso, ou seja, qual problema o modelo resolve e quais normas se aplicam como por exemplo IA usada em credito, saúde, RH, marketing, os tipos de dados utilizados e suas classificações como sensíveis, pessoais, anonimizados, de terceiros.

Os requisitos legais e internos (principalmente) baseados em normas de proteção de dados, políticas corporativas, princípios de ética algorítmica engordam a lista de itens do plano de compliance assim como critérios de rastreabilidade e explicabilidade que seria o grau de interpretabilidade necessário para o modelo em produção. Todos esses elementos são então formalizados m um plano composto por políticas, regras e checkpoints que precisam ser monitorados automaticamente para dar o conforto da implementação em produção. Qualquer semelhança com um processo de diligência a LGPD para garantir a privacidade dos dados dos titulares seria mera coincidência? O conceito é esse.

Em relação a gestão e governança dos planos de compliance, após sua efetiva criação, os mesmos são associados a projetos de IA específicos dentro da plataforma watsonx.governance. A gestão desses planos envolve versionamento, associação a pipelines de ML, papeis e privilégios.

A execução automatizada de checagens (viés algorítmico, consistência de métricas, uso de dados conforme classificação) e alertas e intervenções em caso de violação, são então oferecidos pela plataforma que pode bloquear a publicação do modelo ou exigir revisão manual.

O Enforcement na Prática

A aplicação (enforcement) dos Compliance Plans se dá por meio de políticas automatizadas que definiram regras que impedem o avanço de modelos que não cumpram critérios, Gate reviews que são pontos de controle antes de publicar, revalidar ou reusar um modelo, relatórios e auditoria automatizadas sobre conformidade, prontos para serem apresentados em auditorias.

IBM watsonx.data oferece Integração com outras ferramentas IBM e terceiros como o próprio MD2 Interactive Intelligence que explora as plataformas de dados & IA.

Um caso prático de Governança de IA em um plano de saúde odontológico

Um programa de qualidade de contas odontológicas com IA em uma operadora de saúde que utiliza modelos de machine learning combinados com IA generativa para apoiar a análise de contas médicas recebidas de prestadores de serviços.

O conjunto de dados pode ser composto de documentos estruturados e não estruturados, como guias em PDF, formulários digitalizados e notas de atendimento, Imagens odontológicas, como radiografias intraorais e panorâmicas, dados oriundos do ERP, que consolida informações sobre pacientes, prestadores, procedimentos realizados, valores cobrados e regras contratuais.

O caso de uso é automatizar a análise dessas informações para gerar indicadores de conformidade, identificar possíveis fraudes e apoiar o time de auditoria na tomada de decisões, com alta rastreabilidade. Neste contexto, a IA generativa não é treinada com os dados da empresa, mas, sim, utilizado um modelo pre-treinado, onde conectamos mecanismos RAG, que traz informações relevantes dos repositórios internos como as bases contratuais, regras de cobertura, protocolos clínicos e dados operacionais.

Apesar de não haver treinamento de modelo, o projeto lida com dados sensíveis e requer um controle rígido para garantir proteção a privacidade dos pacientes, em conformidade com a LGPD, evitar que dados pessoais ou clínicos sejam enviados ao modelo de forma inadvertida, controle sobre o que o modelo pode acessar e como pode responder, mitigação de vieses e explicabilidade das decisões automatizadas e finalmente registro e rastreabilidade completa para fins de auditoria.

Assim, o enforcement dos planos de compliance não se aplica ao processo de treinamento, mas sim à intermediação entre os dados corporativos e o consumo da IA generativa para:

– Validação de entradas (prompts e contexto)

O sistema inspeciona os prompts antes que sejam enviados ao modelo. Caso incluam dados pessoais, identificadores de pacientes ou informações restritas, esses dados são automaticamente anonimizados ou bloqueados.

– Controle sobre o RAG

O mecanismo de RAG só pode consultar fontes autorizadas, com filtros configurados conforme o plano de compliance. Isso evita que o modelo acesse dados não permitidos ou que extrapolem o escopo do uso previsto.

– Verificação da saída do modelo

As respostas geradas passam por validação automática. Se houver exposição indevida de dados, a resposta é interceptada, mascarada ou substituída antes de ser apresentada ao usuário.

Cada interação é registrada, incluindo o que foi consultado, quais dados foram acessados, as decisões tomadas pelo sistema e as respostas entregues. Isso permite explicabilidade, prestação de contas e auditoria detalhada.

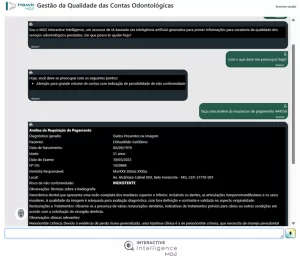

Podemos observar a interação da aplicação de exploração de IA da MD2, o MD2 Interactive Intelligence, interfaceando com modelos de IA e modelos de dados populados com ML onde o enforcement dos planos de compliance estão ativos e a interação fica então controlada com as melhores práticas de compliance, sem impedir o uso inteligente de IA.

“Com a solução IBM watsonx.governance, é possível implementar a camada de controle e segurança de maneira escalável e auditável, protegendo os dados, os usuários e o negócio como um todo e assim viabilizar o uso em produção de IA generativa ou tradicional de acordo com leis e políticas corporativas.” Marcio Guerra – Diretor de Inovação | MD2.